Koçtaş SEO Analizi

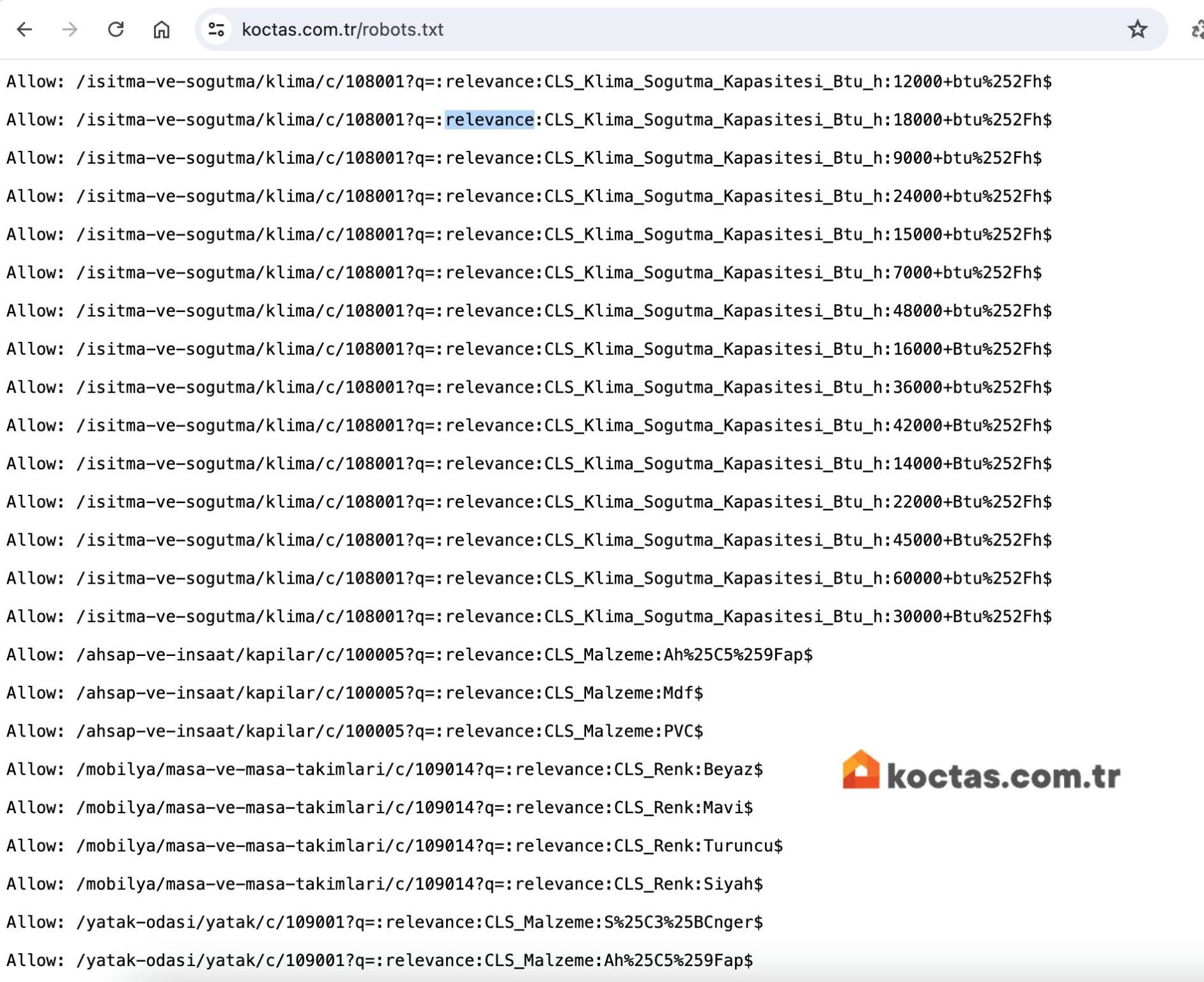

URL’lerin taranmasını sağlamak için robots.txt dosyası üzerinden Allow: komutu ile sayfaların belirtildiğini görüyoruz.

Disallow komutuyla erişimi engellenen belirli dizinlerdeki URL’ler için kısa vadede stratejik olarak tercih edilebilir. Ancak yüzlerce yeni sayfa oluştuğunda bazı sorunlar ortaya çıkabilir.

📌 Tarayıcılar kuralları farklı yorumlayabilir,

📌 Sayfaların keşfedilmesi gecikebilir,

📌 500 KiB robots.txt dosya boyutu sınırına ulaşabilir, (aynı sonuçlanacak satırları birleştirerek azaltabilirsiniz örn: Allow: /*?q=:relevance: taraması istenen URL’lerdeki parametre belirterek tek satırda komut verilebilir. )

Bu durumda, robots.txt dosyası daha çok tarama ve erişim politikalarını kontrol ettiğini ve sitemap.xml yeni sayfaların keşfi için kullanıldığını dikkate alarak çözüm sağlanmalıdır.